Stulecie ewolucji sprzętu do kamer bezpieczeństwa i optyki obrazowej

Prehistoria mechaniczna: od zapisu kinetycznego do prototypów w obwodzie zamkniętym

Techniczna trajektoria kamer bezpieczeństwa nie była sukcesem z dnia na dzień, ale interdyscyplinarną ewolucją obejmującą dwa stulecia. Jej korzenie sięgają końca XIX wieku, kiedy to pojawiły się pierwsze próby uchwycenia ciągłych, dynamicznych obrazów. W 1870 roku angielski wynalazca Wordsworth Donisthorpe opatentował „kinesigraf”, kamerę do ruchomego obrazu, zaprojektowaną do wykonywania serii zdjęć w ustalonych odstępach czasu w celu uchwycenia ruchu.1W 1889 roku Donisthorpe i Louis Le Prince udoskonalili kamery filmowe i technologię projekcyjną; Le Prince opracował nawet 16-obiektywową kamerę, która w tamtym czasie była raczej narzędziem eksperymentalnym, ale położyła fizyczne podstawy do ciągłego monitorowania określonych przestrzeni.1

Pierwszy prawdziwy system telewizji przemysłowej (CCTV) narodził się z potrzeb wojskowych podczas II wojny światowej. W 1942 roku niemiecki inżynier Walter Bruch otrzymał zadanie zaprojektowania i nadzorowania systemu monitorowania wystrzelenia rakiety A4 (V-2) z bezpiecznego bunkra.1Istotą tego systemu był jego „obwód zamknięty”, co oznacza, że sygnały wideo przesyłane były wyłącznie do zaprogramowanych, niepublicznych monitorów. Technologia obrazowania opierała się wówczas wyłącznie na nieporęcznych lampach próżniowych i złożonych obwodach analogowych, bez możliwości nagrywania. Pracownicy ochrony musieli obserwować monitory w czasie rzeczywistym, ponieważ po zniknięciu obrazu informacje zostały utracone na zawsze.2

W 1949 roku amerykańska firma Vericon uruchomiła pierwszy komercyjny system CCTV, wyznaczając przejście z sektora wojskowego do sektora komercyjnego i cywilnego.3Te wczesne systemy komercyjne wykorzystywały głównie stacjonarne czarno-białe kamery połączone kablami koncentrycznymi. Ze względu na wysoką temperaturę, duże zużycie energii i wymagania lamp próżniowych dotyczące napięcia przemiennego 110 V, instalacja była ściśle ograniczona, często wymagając, aby kamera znajdowała się w odległości nie większej niż 6 stóp od gniazdka elektrycznego.5Co więcej, wydajność optyczna była bardzo ograniczona, a rozdzielczość wynosiła zaledwie 240 linii.

Szczyt i niebezpieczeństwa lamp próżniowych: Vidicony kontra Plumbicony

Zanim rozwinęła się technologia obrazowania półprzewodnikowego, jedynym rdzeniem kamer bezpieczeństwa były lampy próżniowe. Urządzenia te były zasadniczo lampami elektronopromieniowymi (CRT) pracującymi w odwrotnym kierunku. W latach pięćdziesiątych XX wieku firmy Weimer, Forgue i Goodrich z RCA opracowały Vidicon, lampę kamerową z pamięcią, wykorzystującą jako cel światłoczuły półprzewodnik (początkowo trisiarczek antymonu).7

Mechanizm fizyczny i ograniczenia materiałowe

Zasada działania tuby kamery polega na skupianiu obrazu na światłoczułym celu za pomocą soczewki optycznej, która jest następnie skanowana wiązką elektronów o niskiej prędkości z działa elektronowego. Kiedy światło uderza w cel, zmienia się lokalna przewodność, powodując wahania prądu wiązki elektronów i przekształcając światło w sygnały wideo.8Vidicon znacznie zmniejszył rozmiar i koszt kamery, czyniąc ją standardem w przypadku nadzoru nieemisyjnego.7

Jednak Vidicon cierpiał na śmiertelną wadę „wypalenia”. W przypadku zbyt długiego skierowania na słońce, silnie odblaskowe powierzchnie lub jasne punkty światłoczuły cel dozna trwałego uszkodzenia fizycznego, tworząc „martwe punkty”.8Ponadto Vidicony były podatne na „efekt mikrofonowy”, podczas którego głośne dźwięki lub eksplozje powodowały fizyczne wibracje cienkowarstwowego celu, powodując powstawanie poziomych pasów na ekranie.8

Aby przezwyciężyć niską czułość i silne „wleczenie” (ogony komety) Vidicona, firma Philips wprowadziła Plumbicon w latach sześćdziesiątych XX wieku. Wykorzystując tlenek ołowiu jako cel, Plumbicon zapewniał wysoki stosunek sygnału do szumu i wyjątkowo niskie opóźnienie obrazu.7Chociaż był skuteczny w nadawaniu, jego wysoki koszt ograniczył jego zastosowanie w bezpieczeństwie do zastosowań wysokiej klasy. Dopiero pod koniec lat 70. XX wieku, wraz z ewolucją technologii słabego oświetlenia, takich jak Tivicon (lampa z diodą krzemową) i Newvicon (produkowana przez firmę Panasonic), lampy próżniowe spełniły podstawowe potrzeby monitorowania w nocy.10

Poniższa tabela podsumowuje ewolucję wczesnych kamer bezpieczeństwa z lampami próżniowymi:

| Faza techniczna | Czujnik rdzeniowy | Rok reprezentacyjny | Linie telewizyjne | Kluczowe funkcje | Ograniczenia |

| Inicjacja | Wczesne lampy fotoelektryczne | 1942 | 100-200 | Zastosowanie wojskowe, obserwacja w czasie rzeczywistym |

Bardzo nieporęczny, bez nagrywania4 |

| Komercjalizacja | Vidicon | Lata 50 | 240 | Prosta konstrukcja, redukcja kosztów |

Łatwe do wypalenia, niska czułość7 |

| Zwiększenie wydajności | Plumbikon | Lata 60 | 400+ | Wysoki SNR, niskie opóźnienie |

Bardzo drogie8 |

| Szczyt analogowy | Newvicon/Saticon | Lata 70 | 480-700 | Wczesna zdolność do pracy przy słabym oświetleniu |

Nadal duży, zależny od zasilania prądem przemiennym10 |

Moment Nobla dla krzemu: narodziny i panowanie CCD

Rok 1969 był kamieniem milowym w historii współczesnego obrazowania. Willard Boyle i George Smith z Bell Labs wynaleźli urządzenie ze sprzężeniem ładunkowym (CCD), osiągnięcie, które później przyniosło im Nagrodę Nobla w dziedzinie fizyki.13CCD zrewolucjonizował sprzęt kamer bezpieczeństwa, zastępując delikatne lampy próżniowe półprzewodnikowymi chipami krzemowymi.13

Sztuka łączenia ładunków: analogia do wiadra z wodą

Zasadę działania przetwornika CCD można porównać do „zestawu wiader zbierających wodę deszczową”. Każdy piksel (atom krzemu) na czujniku działa jak wiadro zbierające fotony (krople deszczu). Efekt fotoelektryczny przekształca fotony w fotoelektrony, które są magazynowane w studniach potencjału. Na etapie odczytu ładunki te są przenoszone rząd po rzędzie niczym sztafeta do wzmacniacza odczytującego i przekształcane na napięcie.13Zaletą technologii CCD jest wysoka jednorodność obrazu i niski poziom szumów, ponieważ wszystkie piksele mają zwykle od jednego do czterech wzmacniaczy odczytu, co zapewnia spójność.13

W 1973 roku Fairchild Semiconductor wprowadził na rynek pierwszy na świecie komercyjny przetwornik CCD, MV-100, o rozdzielczości zaledwie 100x100 pikseli.14Choć początkowo był przeznaczony do użytku przemysłowego i wojskowego, utorował drogę „kieszonkowym” kamerom bezpieczeństwa.16W latach 70. firma Sony zainwestowała oszałamiającą kwotę 20 miliardów jenów w badania i rozwój, ostatecznie wprowadzając na rynek kolorową kamerę CCD XC-1 w 1980 r.18Posunięcie to, uważane wówczas za samobójczy hazard, ugruntowało pozycję firmy Sony na dziesięciolecia jako dominującej siły na światowym rynku przetworników obrazu.19

Złoty wiek monitoringu analogowego i ewolucji PCB

Podczas panowania CCD w latach 80. i 90. radykalnych zmian uległa także elektronika wewnętrzna aparatu. Technologia płytek drukowanych (PCB) została przeniesiona z papieru fenolowego na podłoża z włókna szklanego, znacznie zwiększając stabilność termiczną i integralność sygnału.6W latach 70. płytki PCB obsługiwały tylko okablowanie jednostronne; w latach 80. dwustronne płytki PCB umożliwiły integrację większej liczby komponentów do przetwarzania sygnału (takich jak wczesne procesory wideo) w małych obudowach kamer.6W tym okresie systemy bezpieczeństwa wykorzystywały kable koncentryczne do przesyłania sygnałów analogowych o rozdzielczości sięgającej fizycznej granicy technologii analogowej — około 700 linii telewizyjnych (TVL).5

CMOS APS i rewolucja cyfrowa: od „przechwytywania” do „obliczenia”

Chociaż matryca CCD przez długi czas była liderem jakości obrazu, jej złożona produkcja, wysokie zużycie energii i brak możliwości integracji obwodów logicznych ograniczały dalszą inteligencję aparatu. W połowie lat 90. XX wieku zaczęła dojrzewać technologia uzupełniającego aktywnego czujnika pikselowego z tlenkiem metalu i półprzewodnikiem (CMOS APS).13

Bitwa architektoniczna: CMOS kontra CCD

W przeciwieństwie do „odczytu szeregowego” matrycy CCD, każdy piksel matrycy CMOS ma własny wzmacniacz i obwód odczytu. Architektura ta zapewnia wiele korzyści technicznych:

-

Wysoka integracja:Procesory sygnału obrazu (ISP), przetworniki analogowo-cyfrowe (ADC) i obwody sterujące taktowaniem można zintegrować na tej samej matrycy krzemowej, tworząc system-on-chip (SoC).21

-

Ultrawysoka prędkość:Dzięki tysiącom kanałów odczytu prędkości CMOS mogą być 100 razy większe niż CCD, umożliwiając monitorowanie z dużą liczbą klatek na sekundę (60 kl./s lub więcej) i odtwarzanie w zwolnionym tempie.13

-

Kontrola mocy:CMOS zużywa znaczną ilość energii tylko podczas przełączania pikseli, drastycznie redukując wydzielanie ciepła — czynnik krytyczny dla operacji bezpieczeństwa 24 godziny na dobę, 7 dni w tygodniu.13

W 2007 roku CMOS osiągnął parytet rynkowy z CCD, a do 2019 roku, wraz z popularnością technologii Back-Illuminated (BSI), wydajność CMOS przekroczyła CCD.13BSI zmienia kolejność warstw czujników tak, aby światło docierało do fotodiody przed warstwą obwodu, radykalnie zwiększając efektywność kwantową (QE) i kładąc podwaliny pod nadzór „Starlight”.14

Poniższa tabela porównuje CCD i CMOS w nowoczesnych aplikacjach zabezpieczających:

| Parametr | Czujnik CCD | Czujnik CMOS (APS) | Wpływ na trendy |

| Szybkość odczytu | 1 - 40 MPS | 100 - 400+ MPS |

Włączono strumieniowe przesyłanie wideo HD13 |

| Przeczytaj Hałas | 5 - 10 elektronów | 1 - 3 elektrony |

Poprawiona przejrzystość przy słabym oświetleniu13 |

| Zakres dynamiczny | Wysoka (pełna klatka) | Niezwykle wysoka (HDR) |

Ułatwione przełomy w technologii WDR15 |

| Koszt | Wysoka (linie specjalistyczne) | Niski (standardowy CMOS) |

Napędzał demokratyzację kamer13 |

| Integracja | Niski (zewnętrzne żetony) | Wysoki (jednoukładowy SoC) |

Doprowadzono do kamer Edge AI22 |

Ewolucja soczewek optycznych: od szkła stałego do inteligentnych systemów

Jeśli czujnik jest „siatkówką” aparatu, obiektyw jest jego „soczewką krystaliczną”. Jeśli chodzi o bezpieczeństwo, soczewki muszą zachować zdolność rozdzielczą w bardzo zmiennych środowiskach.

Pokonanie aberracji: powstanie elementów asferycznych

Wczesne soczewki monitorujące były przeważnie kuliste. Fizyczna natura soczewek sferycznych oznacza, że promienie świetlne na krawędziach i w środku nie zbiegają się w tym samym punkcie, powodując aberrację sferyczną i rozmycie krawędzi.26Aby rozwiązać ten problem, w soczewkach zabezpieczających zaczęto masowo stosować elementy asferyczne. Chociaż teorię zaproponował Kartezjusz w 1637 r., dopiero w latach 80. XX wieku precyzyjne formowanie szkła umożliwiło masową produkcję, umożliwiając stosowanie większych apertur (F/1.4 lub F/1.0) bez utraty przejrzystości.27

Zoom i automatyczna korekcja tylnego ogniskowania

W latach 70. zapotrzebowanie na elastyczne kąty widzenia doprowadziło do narodzin obiektywów zmiennoogniskowych. Jednak tradycyjne obiektywy zmiennoogniskowe często tracą ostrość podczas zmiany ogniskowej. Aby zapewnić przejrzystość, w branży opracowano mechanizmy „Regulacji tylnego ogniskowania”, aby utrzymać ostrość zablokowaną na płaszczyźnie czujnika od końca szerokiego do teleobiektywu.29Nowoczesne obiektywy zmiennoogniskowe z napędem silnikowym zawierają precyzyjne silniki krokowe, które automatycznie regulują pole widzenia w oparciu o wyzwalacze alarmowe.26

P-iris: rozwiązanie dylematu dyfrakcyjnego w erze HD

Gdy rozdzielczość czujnika wzrosła z 0,3 MP do 8 MP (4K), pojawiły się wady tradycyjnych obiektywów z automatyczną przysłoną. Konwencjonalne przesłony DC dostosowują rozmiar otworu tylko w oparciu o jasność. w jasnym otoczeniu przesłona zamyka się tak mocno, że powoduje silną dyfrakcję, rozmywając obraz — zjawisko znane jako „granica optyczna”.30

Aby temu przeciwdziałać, firma Axis Communications wprowadziła technologię P-iris (Precise Iris). P-iris nie opiera się wyłącznie na czujnikach światła; wykorzystuje oprogramowanie do komunikacji z silnikiem krokowym w obiektywie.

-

Optymalny wybór przysłony:Oprogramowanie identyfikuje „najlepszy punkt” obiektywu (zwykle jest to średni stopień przysłony) i optymalnie go utrzymuje.30

-

Powiązanie wzmocnienia i ekspozycji:Gdy światło jest zbyt mocne, system priorytetowo traktuje krótszą ekspozycję lub elektroniczną redukcję wzmocnienia, a nie nadmierne zamykanie przysłony, unikając w ten sposób dyfrakcji.30

-

Maksymalna głębia ostrości:W przypadku scen takich jak długie korytarze funkcja P-iris optymalizuje głębię ostrości, aby zapewnić wyraźny zarówno pierwszy plan, jak i tło.33

Postęp dostawcy usług internetowych: powstanie cyfrowego nerwu wzrokowego

Aby dane były widoczne, surowe dane z czujnika muszą zostać przetworzone przez procesor sygnału obrazu (ISP). Ewolucja dostawcy usług internetowych zmieniła monitorowanie bezpieczeństwa z „widzenia” na „widzenie wyraźnie i dokładnie”.

Techniczne ścieżki do szerokiego zakresu dynamiki (WDR)

W scenach oświetlonych od tyłu (takich jak okno bankowe) różnica między jasnymi i ciemnymi obszarami może przekraczać 100 000x. Dostawcy usług internetowych radzą sobie z tym trzema głównymi metodami:

-

Cyfrowy WDR (DWDR):Algorytm oprogramowania, który dostosowuje krzywe gamma w celu rozjaśnienia ciemnych obszarów. Niski koszt, ale wysoki poziom hałasu.35

-

Prawdziwy WDR (fuzja wielokrotnej ekspozycji):Główne rozwiązanie high-end. Dostawca usług internetowych instruuje czujnik, aby wykonał dwie klatki w krótkim odstępie czasu: jedną krótką (prześwietlenia) i jedną długą (cienie). Rejestracja na poziomie pikseli następnie płynnie je łączy.36

-

Kryminalistyczny WDR:Zoptymalizowana wersja pod kątem redukcji artefaktów związanych z ruchem, zapewniająca, że poruszające się obiekty nie będą miały efektu „duchy”, co ma kluczowe znaczenie dla rozpoznawania tablic rejestracyjnych.25

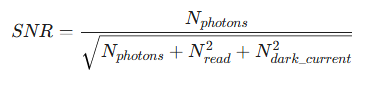

Stosunek sygnału do szumu (SNR) w algorytmach ISP można opisać za pomocą:

Ekstremalne przełomy w słabym oświetleniu: światło gwiazd i światło czarne

Ostateczną granicą bezpieczeństwa jest ciemność. Tradycyjne widzenie w nocy w podczerwieni powoduje utratę kolorów, co uniemożliwia identyfikację kolorów odzieży lub pojazdu.40

Trzy filary sprzętowe kamer „Starlight”.

Sukces Starlight opiera się na przekraczaniu fizycznych granic:

-

Czujniki wielkoformatowe:Korzystanie z czujników 1/1,8 cala lub nawet 1/1,2 cala. Zwiększa to obszar odbioru światła na piksel, wychwytując więcej fotonów.39

-

Optyka o bardzo dużej aperturze:Wyposażony w obiektywy F/1.0 lub F/0.95, zapewniające 4x większy pobór światła w porównaniu ze standardowymi obiektywami F/2.0.26

-

Algorytmy wolnej migawki:Układanie ramek u dostawcy usług internetowych w celu wydłużenia czasu integracji. Chociaż wprowadza to pewne rozmycie ruchu, tworzy kolorowe obrazy przypominające dzień w środowiskach o natężeniu 0,001 luksa.24

Połączenie dwóch czujników Blacklight (DarkFighter X).

Gdy natężenie światła spadnie poniżej 0,0001 luksa, samo wzmocnienie nie wystarczy. Producenci tacy jak Hikvision (DarkFighter X) i Keda wprowadzili na rynek technologię Blacklight, która naśladuje pręciki i czopki ludzkiego oka:

-

Podział optyczny:Specjalistyczny pryzmat dzieli światło na ścieżki podczerwone i widzialne.44

-

Podwójne czujniki:Jeden czujnik rejestruje podczerwień (luminancję i szczegóły), podczas gdy drugi rejestruje słabe światło widzialne (kolor).

-

Fuzja na poziomie pikseli:Dostawca usług internetowych dopasowuje obie ścieżki w czasie rzeczywistym, zapewniając jasny, pełnokolorowy obraz wideo o niskim poziomie szumów. Wymaga to dokładności kalibracji wynoszącej subpiksel.44

Synergia wielu obiektywów i obrazowanie obliczeniowe: nowa era

Nowoczesne monitorowanie wykracza poza pojedynczą perspektywę w kierunku wielosensorowych platform termojądrowych.

Panoramiczne łączenie (PanoVu) i połączenie dwóch obiektywów (TandemVu)

Aby pokryć rozległe obszary, takie jak place czy lotniska, seria PanoVu firmy Hikvision integruje od 4 do 8 czujników. Algorytmy ISP wykonują „bezproblemowe łączenie”, które obejmuje:

-

Spójność ekspozycji:Zapewnienie jednakowej jasności we wszystkich czujnikach.45

-

Rejestracja pikseli:Eliminacja martwych punktów i odbić w szwach.45

-

Monitorowanie wielokierunkowe:Jeden adres IP i jeden kabel mogą obsługiwać widok 360 stopni, redukując koszty systemu.47

Fotografia obliczeniowa i inteligentne oświetlenie

Obrazowanie obliczeniowe zaciera granicę pomiędzy sprzętem i oprogramowaniem.

-

Inteligentne światło hybrydowe:Kamery takie jak Smart Hybrid Light firmy Hikvision wykorzystują sztuczną inteligencję do przełączania z dyskretnego trybu podczerwieni na tryb koloru białego światła po wykryciu osoby lub pojazdu.41

-

Fuzja wielospektralna:Łączenie światła termicznego (LWIR) i światła widzialnego. Termowizja wykrywa ciepło (ukryte cele), a widzialność je identyfikuje, znacznie poprawiając dokładność ochrony obwodowej.51

Wizja 2030: przełomowa przyszłość sprzętu zabezpieczającego

Patrząc w przyszłość do roku 2030, forma kamer bezpieczeństwa ulegnie kolejnej jakościowej zmianie.

Obrazowanie bezsoczewkowe i czujniki kwantowe

Badania sugerują, że „kamery bezobiektywowe” oparte na optyce obliczeniowej dojrzewają. Dzięki zastosowaniu cienkich koderów optycznych zamiast szklanych soczewek kamery mogą stać się cienkie jak naklejki.20Co więcej, jednofotonowe diody lawinowe (SPAD) umożliwią obrazowanie w warunkach zerowego oświetlenia (zliczania fotonów).20

Rozpoznawanie emocji i intencji

Do 2030 r. kamery nie będą już tylko narzędziami wizualnymi:

-

Monitorowanie biometryczne:Wykorzystanie laserowych wibrometrów Dopplera dalekiego zasięgu do rejestrowania bicia serca i oddechu.55

-

Analiza emocji:Głębokie sieci neuronowe będą analizować mikroekspresje i mowę ciała, aby „przewidywać zamiary” przed wystąpieniem przestępstwa.55

-

Autonomia krawędziowa:Dzięki sieci 5G/6G i chipom AI o niskim poborze mocy kamery będą działać jak „cyfrowi strażnicy”, przeprowadzając wszystkie analizy lokalnie i przesyłając zaszyfrowane dane za pośrednictwem protokołów kwantowych.3

Wniosek: Stulecie podsumowane w świetle i cieniu

Ewolucja kamer bezpieczeństwa to historia niekończącego się dążenia ludzkości do „widoczności”. Od maszyny bunkrowej z 1942 r. po dzisiejszy terminal oparty na sztucznej inteligencji, zapewniający fuzję na poziomie pikseli i kolorowy noktowizor – każdy krok był triumfem nad fizycznymi ograniczeniami. Obiektywy przeniesione ze sferycznych na asferyczne, a przysłony z ręcznych na P-iris; czujniki przeszły z nieporęcznych lamp na BSI CMOS i skierowały się w stronę wykrywania kwantowego; Technologia PCB została przeniesiona z prostych połączeń na wysokowydajne platformy SoC.

Przyszłością bezpieczeństwa nie będzie zbiór zimnego sprzętu, ale połączenie fizyki, półprzewodników i sztucznej inteligencji. Chroniąc społeczeństwo, prawdziwym wyzwaniem na następną dekadę będzie znalezienie równowagi między postępem technologicznym a etyką prywatności.